Explicabilidad vs interpretabilidad en la IA

En un artículo anterior discutimos la naturaleza de la explicabilidad, pero cuando hablamos de IA, otro término que viene a la mente y que a menudo se usa como sinónimo es la interpretabilidad. Ahora profundizaremos en las diferencias entre ambos términos.

¿Explicabilidad o interpretabilidad?

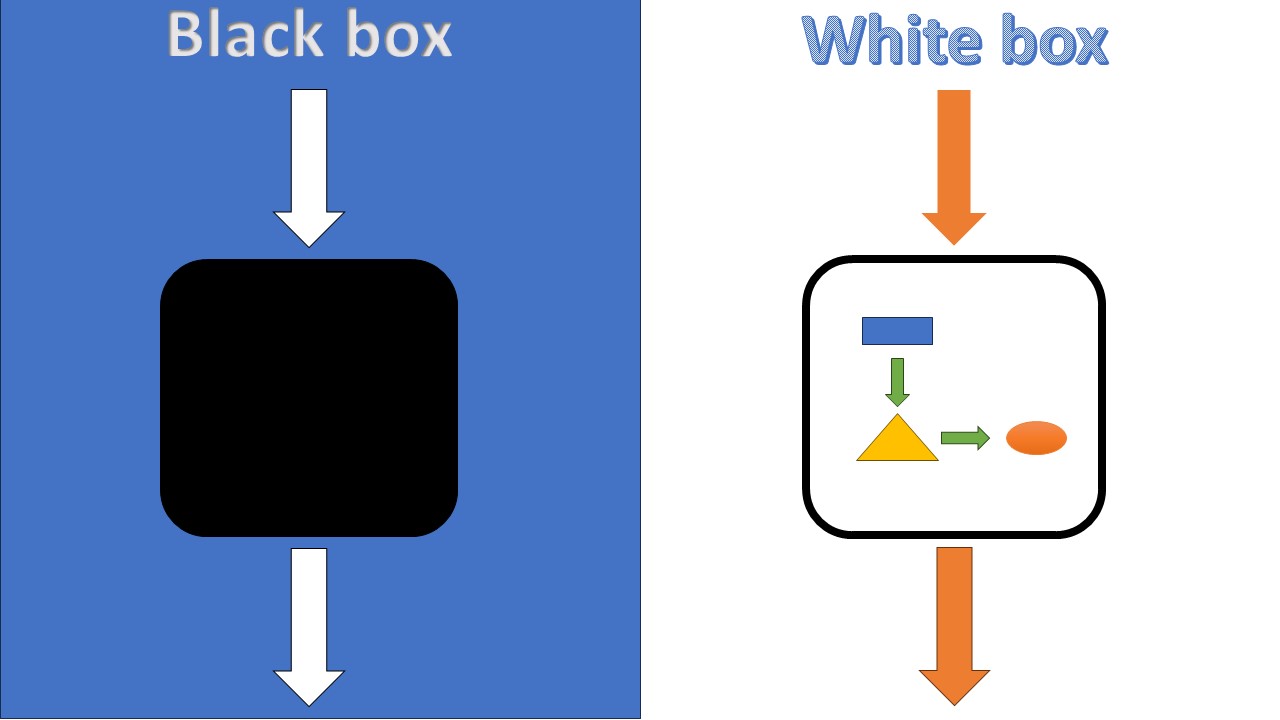

Mientras que la explicabilidad se centra en proporcionar razones para las decisiones del modelo, la interpretabilidad va más allá de las explicaciones para mejorar la comprensión general. Un modelo de IA interpretable no solo explica sus decisiones, sino que también presenta su lógica interna de manera transparente y comprensible. Esta distinción es crucial para garantizar que los sistemas de IA no solo sean explicables, sino también interpretables, permitiendo así obtener una comprensión más profunda y tomar decisiones mejor fundamentadas.

En el contexto de la IA, los modelos «white box» se caracterizan por ser completamente transparentes, lo que facilita tanto su interpretabilidad (entender cómo funcionan) como su explicabilidad (justificar sus decisiones). En contraste, los modelos «black box» ocultan su funcionamiento interno, lo que dificulta tanto la interpretación como la explicación de sus decisiones, aunque pueden ofrecer un mejor rendimiento en tareas complejas.

Clase de cálculo: Límites y derivadas

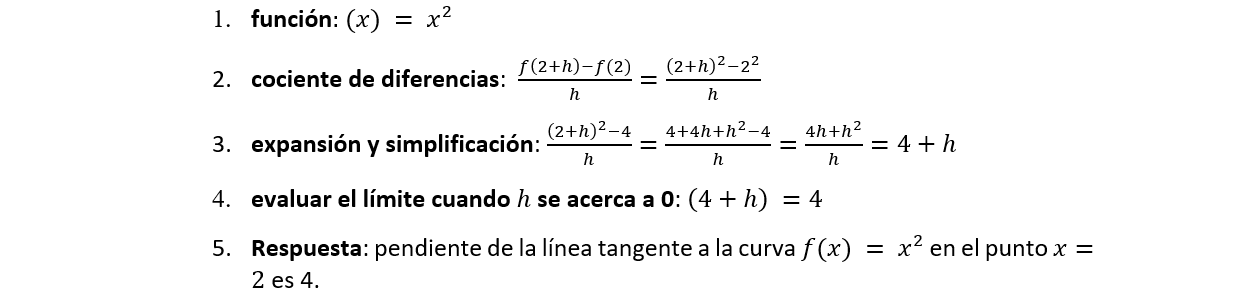

Interpretabilidad: Solución usando límites

En este ejemplo, cada paso se presenta de manera clara, lo que hace que la solución sea altamente interpretable. Cualquier persona familiarizada con cálculo puede seguir el razonamiento y entender cómo se obtuvo la respuesta.

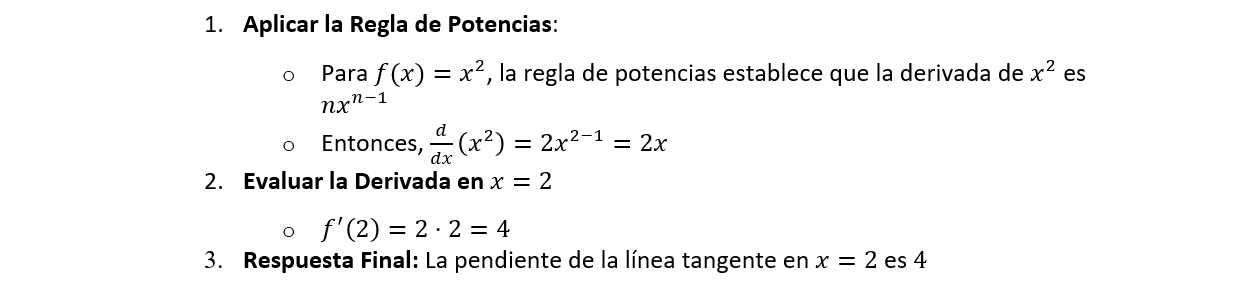

Explicabilidad: Usando reglas de derivación

Ahora, resolvamos el mismo problema utilizando las reglas de derivación, que se pueden considerar como un enfoque más sofisticado, similar a la manera en que la IA procesa en ciertos escenarios los datos.

En este enfoque, la respuesta final es la misma, pero el proceso es diferente. En lugar de mostrar los pasos detallados de la definición del límite, utilizamos la regla de potencias, una regla de derivación bien establecida en cálculo. Este método es menos transparente en cuanto a mostrar cada pequeño paso, pero proporciona una explicación clara y comprensible del proceso.

¿Cuál usar?

Al abordar un nuevo proyecto de IA, es esencial considerar las necesidades de interpretabilidad teniendo en cuenta lo siguiente:

- ¿Es la interpretabilidad un requisito empresarial crítico? Si existen regulaciones o requisitos comerciales que demandan una transparencia total del modelo, deberías optar por un modelo interpretable.

- ¿Se puede utilizar mi conjunto de datos en un modelo más simple? Comienza con algo simple. Sí puedes cumplir con el objetivo utilizando un método de IA/ML interpretable que ofrezca total transparencia, selecciona ese enfoque.

- ¿Cómo manejo conjuntos de datos grandes o tipos de datos complejos? Cuando trabajes con conjuntos de datos grandes o tipos de datos complejos, como audio, imágenes o texto, pueden ser necesarios modelos más avanzados. En tales casos, enfocarse en la explicabilidad en lugar de la interpretabilidad podría ser más apropiado.

Reflexión final

Tanto la interpretabilidad como la explicabilidad son críticas en la IA, al igual que lo son al resolver problemas matemáticos. La interpretabilidad implica proporcionar soluciones claras y paso a paso, haciendo que cada aspecto del proceso de decisión sea transparente. La explicabilidad, por otro lado, se centra en proporcionar explicaciones comprensibles para los resultados, incluso si los procesos internos son complejos.

Al garantizar que los sistemas de IA puedan explicar sus decisiones de una manera que los humanos puedan entender, podemos generar una mayor confianza y asegurar que estos sistemas se utilicen de manera efectiva y responsable. Así como en la clase de matemáticas, el proceso es tan importante como la respuesta, y deberías elegir el enfoque adecuado para cumplir con los requisitos de tu proyecto.